爱奇艺路香菊:视频人物识别关键技术及其应用|爱奇艺技术沙龙回顾

爱奇艺路香菊:视频人物识别关键技术及其应用|爱奇艺技术沙龙回顾

主讲人 | 路香菊 爱奇艺科学家

张康 编辑整理

量子位编辑 | 公众号 QbitAI

近日,爱奇艺技术沙龙“多模态视频人物识别的关键技术及应用”成功举办,爱奇艺科学家路香菊出席并作出精彩分享。

路香菊博士,爱奇艺科学家,PersonAI团队负责人,专注人物识别及视频分析,创建百万人物库及两万卡通库。组织创办“爱奇艺多模态视频人物识别赛”,开放全球首个影视视频人物数库iQIYI-VID。

以下为路香菊分享实录:

今天给大家分享的主题是“爱奇艺多模态人物识别及其应用”,主要有三个方面:

智能创作:优质信息流内容是比较宝贵的,给大家分享AI在创作里的能力;

多模态AI竞赛:爱奇艺多模态视频人物识别AI竞赛,以及iQIYI-VID人物视频库。

人物识别

人脸识别可能大家都不陌生,但人物识别并不等同于人脸识别。人物识别除了通过人脸识别,也可以采用其他技术,比如说人体(reID)、声纹等。当然爱奇艺主要是视频资源,针对明星会采用人脸识别,针对动漫等卡通剧,会采用虚拟人物识别。

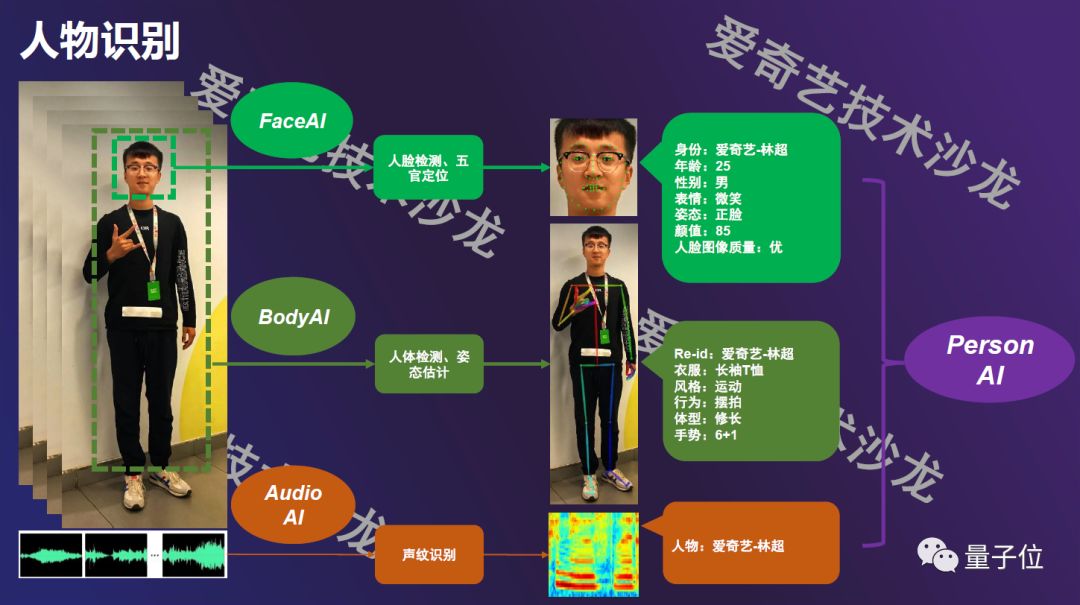

这是爱奇艺人物识别简单的技术总蓝图,通过这张图可以比较形象的认识人物识别,分为FaceAI,BodyAI,AudioAI。

FaceAI是广义的人脸识别,但是除了人脸,还包含更多属性,如五官定位、是否戴眼镜、表情,以及人脸质量、姿态、颜值、种族等等之类的,是广义的人脸信息。

BodyAI除了我刚才说的reID(人的姿态、身体特征),还可以通过服饰、职业、体型等属性来确定一个人的身份。

AudioAI主要是指声纹,比如音乐类型,声音类型,音频分类等工作,是指比较立体的AI信息。

爱奇艺人脸识别模型

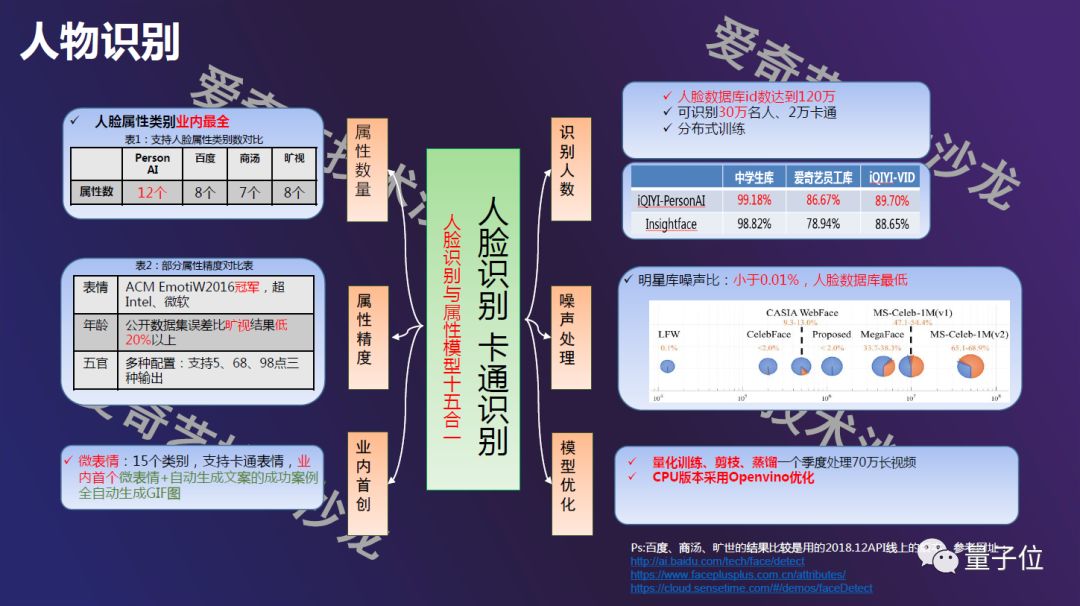

爱奇艺的人脸识别模型,除了人脸的身份之外,还有其属性信息,目前线上跑的模型包含12个属性,比工业界的其他公司模型要更全面。爱奇艺人脸识别与属性模型十五合一,其每个属性的指标都在行业内领先,一个模型可以同时识别身份属性,且各项属性的识别精度也比较高。

爱奇艺的人物库,包含120万名人,2万虚拟形象(卡通人物)。目前人脸识别精度最高的是ArcFace,可以达到99.8的精度。爱奇艺和ArcFace做过比较,是领先于它的。

爱奇艺的模型之所以达到这么高的精度,主要是因为我们有一个大规模的明星数据库,这个数据库的噪声小于0.02。

此外像分布式训练,还有量化、剪枝、蒸馏,还有CPU版本的OpenVINO优化,也都是我们在这个模型的尺寸大小上做的一些优化的工作,这个模型一天可以分析2000以上的长视频,一个月可以分析几十万的视频总量。这对处理海量视频是一个非常重要的一个指标。

大家都比较熟悉这种表情包,爱奇艺这项技术实现了业内首个表情和文案的自动生成。一个长视频平均能提取出来100多个明星表情包,文案也是自动生成的。除了明星,我们也在做卡通人物相关的实验,可以做到40多个表情包。

目前生成对抗网络的应用较多,比如GAN生成的人脸非常逼真,其实生成的人脸虽然在某些样本上取得非常逼真的效果,但目前在标题自动生成、画面自动生成领域都还没有十分成熟。举例来说,生成卡通形象,有些生成的很好,但有时鼻子就跑到脑袋上了。

爱奇艺表情文案生成采用了配准的方式。对于明星表情包,我们首先检测出他的Action Unit,然后将AU的特征向量与GIF库中的特征向量配准,再根据颜值、性别等信息,把相应GIF上的文案放到明星的表情包上。配准的效果要好很多,不会出现特别怪异的文字或画面。

爱奇艺人脸识别的应用

爱奇艺有海量的明星资源,需要把视频的信息结构化,需要知道视频里人物的相关信息。下面分享几个应用场景。

“爱创媒资系统”应用于后期制作,“艺汇”可应用于导演智能选角。这两个应用在2018年分别获得CCF科学技术进步杰出奖和优秀奖。

举例说明:

AI剪辑师综艺的制作方式:有几个人在舞台上跳舞,台下有很多机器进行拍摄,而拍摄的视频资源跟节目资源比例大约是1000:1以上。也就是说你看到的一个小时的节目,后期制作人员要处理一千个小时以上的视频素材。因此后期人员如果想在这大量的视频素材中找到某个人的一些镜头,非常耗人力、耗时间。而通过人脸识别就可以快速实现某个人的镜头索引,还可以对其表情、首饰等打标签,实现视频编目的自动化。

在爱奇艺APP中,通过“只看Ta”功能,可以实现只看某个演员或者某对CP的功能,这是AI人物识别在爱奇艺的典型应用之一。此外还有助于演员回顾自己演戏的内容。

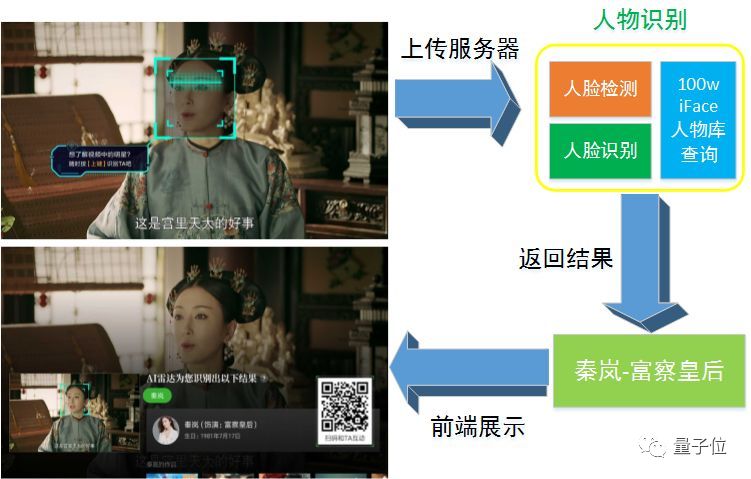

另一个应用是AI雷达功能,用户在看电视的时候,可以通过按遥控器识别画面中的人物,识别同款服饰、车等实现商品的检测。

智能创作

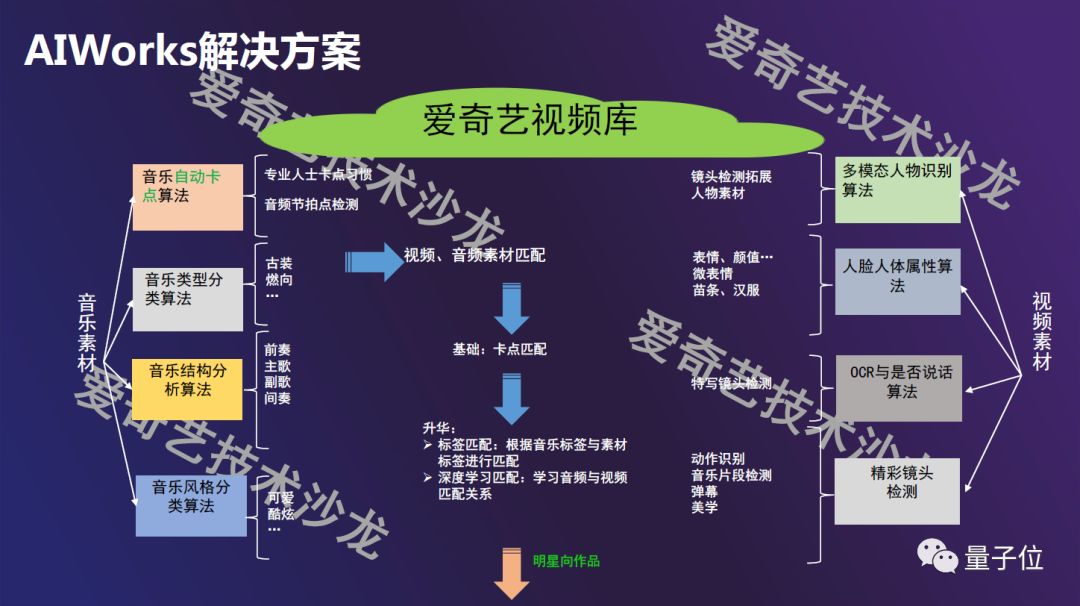

智能创作是一个非常综合的AI应用,想要让AI生成一个观赏性很强的视频,需要我们对画面、声音、文本以及画面效果等进行综合分析,才能产出比较有观赏性的视频。

人工剪辑视频,需要在音频素材、音乐类型、海量视频素材中挑选、剪辑,非常耗时,而且不同剪辑师的差异非常大。

而AI更方便利用海量的素材,做成模板、量化生产,而且可以实现任意技术的组合,能制作出很多不同风格的视频。

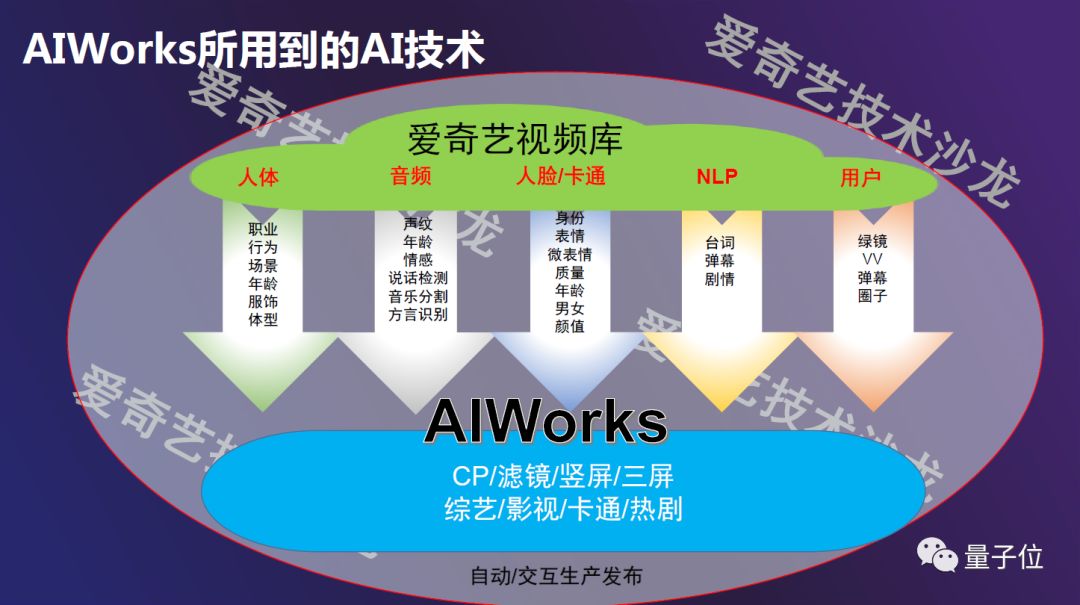

AIWorks可以实现根据剧本自动搜索素材,智能生成符合某个话题的视频集锦,支持不同画面的不同输出方式,如横竖屏效果、自动卡点配乐、台词集锦、CP 等。

上述视频展示的是台词搜索功能,涉及到的技术主要包括人脸识别、人脸表情等属性识别、场景识别、服饰和职业识别、台词 OCR、NLP、声音和音乐检测、音乐节拍点提取、镜头切分、专场特效、视频滤镜等模态。

台词分析是很好的剧情统计解决方案,对与智能创作也非常有帮助。

漫威老爷子在他导演的100 多部大片中,均有几秒钟的客串镜头,如果想剪辑出只有他出现的镜头并拼接成短视频,纯人工剪辑师的工作量和工作难度有多大可想而知。但是AIWorks通过人物识别,可以在1分钟内完成,这也是AI的优势之一:AI可以在海量的素材中,精准找到我们想要的特定内容。

我们可以看到,上述智能创作应用了非常多技术,包括美学的,镜头切分的,人物识别的,表情分析的,音乐卡点的等等。一个完整的智能创作解决方案,基本上用到了目前所有的AI技术。

有很多人问过我,AI是不是会取代剪辑师?我觉得这是永远不可能的。比如一些复杂场景的画面,AI很难去理解其中的含义。人类的创造力非常强,AI取代不了高水准的艺术家、创作师、内容制作群体,但是AI可以帮助他们提高制作效率,创作出高品质的作品。

爱奇艺AI竞赛

多模态技术和应用难点

最后我介绍一下爱奇艺“多模态视频人物识别挑战赛”以及iQIYI-VID数据库。

为什么多模态是必要的?通过上述介绍,可以发现,单纯的人脸识别,或者声纹模型,或者五官定位,都只是单一的问题。而我们希望AI能为我们提供一些solution,是技术的综合使用。

目前国内多模态研究的发展速度非常快,并且取得了一定的进展,但是还有非常大的发展空间。多模态信息之间怎么融合,如何训练、加速等问题还在探索当中。

因此爱奇艺从2018年开始举办多模态人物识别竞赛,并发布了视频数据库iQIYI-VID,希望引起学术界对人物识别的持续关注和研究。借助iQIYI-VID数据集,可以拓展人脸识别技术,推进多模态人物识别技术创新,以解决大数据时代实际视频媒体人物信息结构化的需求,把更多的学术成果转化成实际中的生产力。

爱奇艺多模态视频人物识别挑战赛

今年,爱奇艺与ACMMM联合举办多模态挑战赛,向全球参赛者开放最接近实际媒体应用场景的视频人物数据集(iQIYI-VID-2019)。

数据集包含复杂场景下10000名明星人物、200小时、20万条影视剧与短视频。经过严格的人工标注,抽样精度大于99.8,有利于评价模型性能,也非常有挑战性。

iQIYI-VID数据集在业界难度比较大,能够给大家提供更好的发挥空间,并且参赛者在后续也可以发出很好的论文。去年Arcface的一个团队参加了爱奇艺多模态视频人物识别挑战赛,取得了第一名,并且今年发表了一篇论文,中了2019 CVPR的Oral Paper。

参加本次挑战赛,能在视频人物识别算法上利用头部、声音、人体等多模态特征融合信息和更少的模型,进一步将精准度提高,能够在视频人物身份识别技术上取得重要突破。

本次大赛,目前已有来自世界各地的235支队伍参与报名。参赛队伍有来自Nvidia、ReadSens、百度、科大讯飞,网易等公司的企业团队,也不乏来自UCL、埃克塞特大学、清华大学、中科院等海内外知名学府的高校团队。

iQIYI-VID-2019已于4月29日开放结果入口,具体上传方式参见Help_Document。文档下载链接:

http://challenge.ai.iqiyi.com/detail?raceId=5c767dc41a6fa0ccf53922e7&tabIndex=1

本次大赛的报名截止日期为5月10日,欢迎有志团队把握好时间,报名参与。戳“阅读原文”,直达本次大赛报名通道。

— 完—